站长心海前言: 欢迎回到心海漪澜的“AI 实验室”!在过去的几个月里,我们见证了大模型圈的疯狂内卷。就在近期,国内 AI 巨头智谱(Z.ai)悄悄扔出了一枚真正的“重磅炸弹”——GLM-5。 这个模型不仅参数量惊人,更关键的是,它在代码编写和超长任务处理(Agentic tasks)上直接对标了最顶级的闭源模型。最让咱们折腾党兴奋的是,英伟达(NVIDIA)居然第一时间把它接到了自家的开发者平台(NIM),并且免费赠送调用额度! 今天,心海就带大家全方位解析这台“国产性能怪兽”,并手把手教你如何白嫖 NVIDIA 的企业级 API 接口!

🧐 GLM-5 凭什么被称为“开源天花板”?

很多朋友可能觉得现在开源模型满天飞,GLM-5 有什么特别的?心海给大家划几个硬核重点:

- 恐怖的参数量与 MoE 架构: GLM-5 从上一代的 355B 直接飙升到了 744B(7440亿)总参数量,并且采用了混合专家(MoE)架构,每次推理仅激活 40B 参数。这意味着它不仅变聪明了,而且运行效率极高。

- 205K 超长上下文与 DSA 技术: 它集成了类似 DeepSeek 的稀疏注意力机制(DSA),在保持 20.5 万 tokens 超大上下文窗口的同时,大幅降低了显存占用和部署成本。你可以直接把几十个代码文件或者一整本厚厚的英文财报塞给它。

- “纯血”国产算力奇迹: 最具极客精神的一点——据报道,这么庞大的模型,是完全脱离美国芯片,百分之百使用华为昇腾(Ascend)芯片训练出来的。

- Agent(智能体)的完美大脑: 智谱官方给它的定位是专攻“复杂系统工程和长周期智能体任务”。在各大权威评测中,它的逻辑推理和代码能力稳居全球开源模型第一梯队,极大缩小了与最强前沿模型的差距。

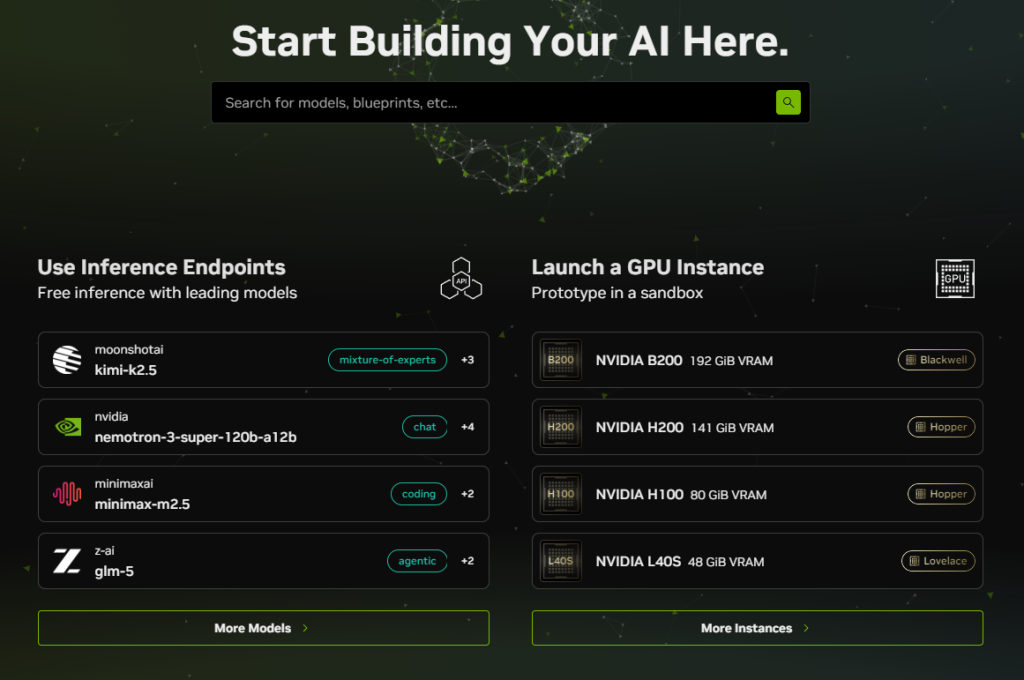

🛠️ 白嫖指南:通过 NVIDIA NIM 零门槛调用 GLM-5

对于咱们普通开发者来说,要在本地跑起 744B 的巨无霸,哪怕是量化版,对显存的要求也是极其变态的。 好在老黄(NVIDIA)非常大方,在自家的 NVIDIA NIM 微服务平台上直接上线了 GLM-5,只要你是开发者,就能直接领额度免费调用!

第一步:注册并获取 NVIDIA API Key

- 浏览器打开英伟达的开发者平台:build.nvidia.com。

- 在右上角点击 Login,直接使用你的邮箱、Google 或 GitHub 账号授权登录。

- 登录后,在搜索框搜索

glm-5,或者直接在模型列表里找到它。 - 进入 GLM-5 模型页面,点击右上角的 Get API Key(获取 API 密钥)。

- 复制这串形如

nvapi-xxxxxx的密钥,妥善保存,千万别泄露!

第二步:使用 Python 优雅地调用(完美兼容 OpenAI 格式)

NVIDIA NIM 最良心的一点在于,它的接口完全兼容 OpenAI 的 SDK!这就意味着你原来写好的接入 ChatGPT 的代码,只需要改两行配置,就能无缝切换到 GLM-5。

在你的服务器或本地环境,打开终端安装 OpenAI 官方库:

pip install openai

新建一个 test_glm5.py 文件,复制以下测试代码:

from openai import OpenAI

# 填入你刚刚在 NVIDIA 平台白嫖到的 API Key

NVIDIA_API_KEY = "nvapi-你的真实密钥"

# 初始化客户端,将基础 URL 替换为 NVIDIA 的统一接口

client = OpenAI(

base_url="https://integrate.api.nvidia.com/v1",

api_key=NVIDIA_API_KEY

)

print("🚀 正在连接 NVIDIA 服务器,呼叫 GLM-5 大脑...")

completion = client.chat.completions.create(

model="z-ai/glm5", # 指定调用 GLM-5 模型

messages=[

{"role": "system", "content": "你是一位精通 Linux 和网络架构的资深极客站长。"},

{"role": "user", "content": "请帮我写一段 bash 脚本:每天凌晨 3 点自动备份 /var/www/html 目录到 /backup,并保留最近 7 天的压缩包。"}

],

temperature=0.5,

max_tokens=1024

)

print("\n🤖 GLM-5 回复:\n")

print(completion.choices[0].message.content)

第三步:运行与享受

运行脚本 python3 test_glm5.py,你就能以极快的速度(毕竟背后是老黄极其庞大的算力集群)看到 GLM-5 给你输出的高质量代码了!

💡 站长总结

通过 NVIDIA 开发者平台白嫖 GLM-5 API,绝对是近期最高效、性价比最高的顶级 AI 接入方案。不管你是想把它接入到之前我们写的 OpenClaw 智能体里,还是单纯用它来翻译文献、写脚本,GLM-5 的表现绝对不会让你失望。

新号注册 NVIDIA 开发者通常会赠送充足的可用额度(Credits),对于咱们个人的日常测试和轻度使用来说,妥妥够用。

心海漪澜

心海漪澜

评论前必须登录!

注册